티스토리 뷰

안녕하세요 :) Zedd입니다.

흠 이미지 관련 WWDC영상들을 찾아보다가 Depth관련 영상들이 쫌 있는걸 보게되었어요.

보자마자..Depth가 뭐지..? 프레임워크인가?

근데 검색해봐도 Depth라는 프레임워크 문서는 없음zzz

그냥 Depth가 뭔지 궁금해서 쓰는 글입니다..

Image Editing with Depth라는 WWDC 2017 영상 메모글..!? 이라고 생각하면 될듯 ㅎ

근데 개길어서 ㅎ 다 못볼듯 ㅎ

오늘의 목적 : Depth가 뭔지 아는것.

(근데 Depth는 몰라도 TrueDepth는 들어봤을걸..)

역시 Depth가 뭔지가 제일 먼저 나오는군

Q : ㅇ ㅑ!!!!!!!!!! Depth가 몬데

A : ㅇㅋ 설명해드림.

일단 Depth가 뭔지 알려주기 전에, 이 Depth를 포착(capture)하는 방법부터 알랴드림

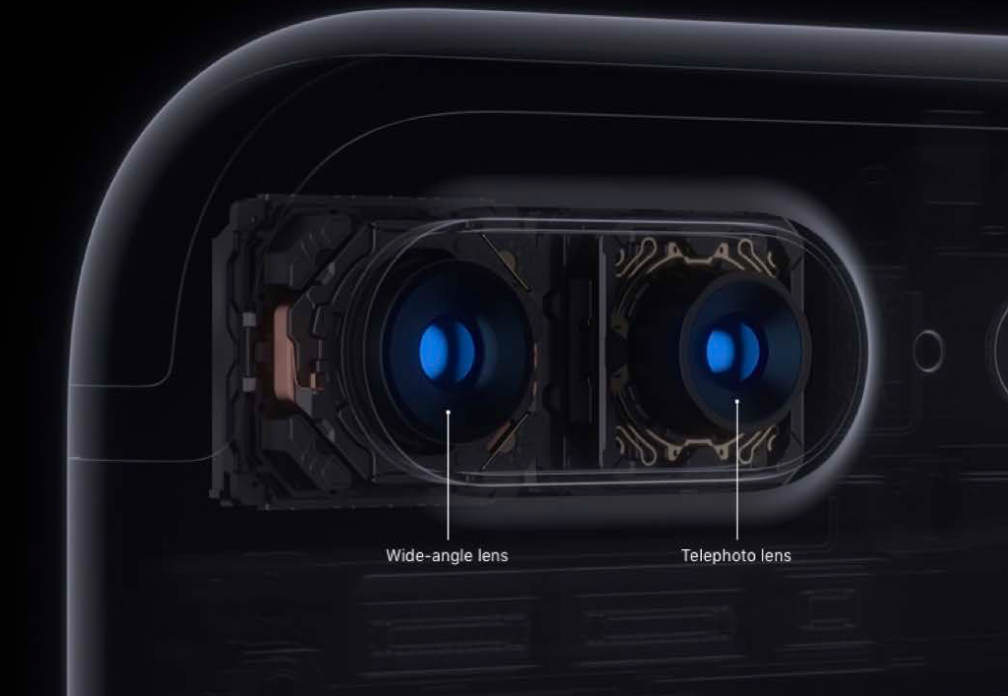

Depth는 듀얼 카메라 시스템이 있는 iPhone 7+ 및 iOS 11에서만 capture할 수 있음.

(뭐 듀얼카메라 있으면 Depth는 다 capture할 수 있겠죠?)

듀얼 카메라 시스템은

동일한 장면의 두 이미지를 동시에 동일한 초점거리(focal length)로 캡쳐하도록 설정할 수 있는 기능임 (;;;;;)

두 이미지의 차이점을 disparity(시차)라고 합니다.

자 여러분...시차가 그 시차가 아닙니다..

아주 좋은 설명이 있는 블로그가 있는데요. https://bskyvision.com/33참고하시기 바랍니다.

간단하게 요약하면

왼쪽 눈만 떴을 때, 오른쪽 눈만 떴을 때 보이는 시야가 조금 다르죠?

이 왼쪽 뷰와 오른쪽 뷰의 차이를 이용해

뇌는 사물을 "입체적"으로 보고 "깊이감(Depth!!)"을 느낀다고 합니다.

물론 눈이 하나만 있어도 입체감/깊이감을 느낄 수 있지만,

두 눈의 망막에 맺힌 상들의 차이만큼 입체감/깊이감을 분명하게 느끼게 해줄 수 있는건 없다고 해요.

아직 시차가 잘 이해가 안가실 수도 있는데요.

이렇게 7+에 듀얼카메라가 있잖아요! 저게 우리 눈이라고 생각하시면 돼요.

한쪽눈으로 찍은거랑 다른 한쪽눈으로 찍은거. 우리가 사진을 찍을때 어떤 특정장면을 찍잖아요?

물론 우리도 항상 어떤 특정 뷰를 보고 있는거고....

우리가 가만히 어떤 한곳을 보고 있는데,

그게 왼쪽눈으로만 본거랑 오른쪽눈으로만 본거랑 차이가 있는거잖아요.

듀얼 카메라 시스템도 동일한 장면을 찍지만 각자 찍은게 다른거고,

그럼 우리가 찍은 2장의 사진이 있을건데, 그 이미지의 차이를 disparity. 시차라고 하는거에요!

신기허다..

자, Depth이야기 하다가 disparity이야기로 샜는데...

disparity를 알면 간단한 공식으로 Depth를 계산할 수 있게 됩니다.

Depth는 1 / disparity입니다!

왼쪽은 7+로 찍은 사진이고 오른쪽은 disparity map.(직역하면 시차 지도...??)

disparity map을 보면 밝은영역이 있고 어두운 영역이 있어요~

밝은 영역은 카메라에 더 가깝고 더 높은 시차값에 해당하고,

(Depth는 1 / disparity라고 했으니 Depth가 작은거겠지..?)

어두운영역은 카메라에 더 멀리 떨어져있고 낮은 시차값에 해당한다고 합니다.

오..더 높은 시차 => 이미지간 차이가 많이 난다...인데

한손을 두눈 중앙 완전 가까이에 대보세요. 그리고 한쪽눈씩 감으면서 차이를 보세요!

저는 차이가 많이나서 깜짝놀랐어요zzzz

그리고 손을 쭉 뻗고 또 한쪽눈씩 감으면서 차이를 봐봅시다.

차이가 별로 안나죠?

동일하다고 생각하면 되는걸까요!? ㅎㅎ...확실하진 않습니당.

아니 제가 큼큼...듀얼카메라가 아니라ㅓㅅ...ㅎ!!! 이걸 직접 내 폰에서 볼 수 있다는 건가..?

듀얼카메라...이신분들...disparity map을 폰에서 볼 수 있나요...??..

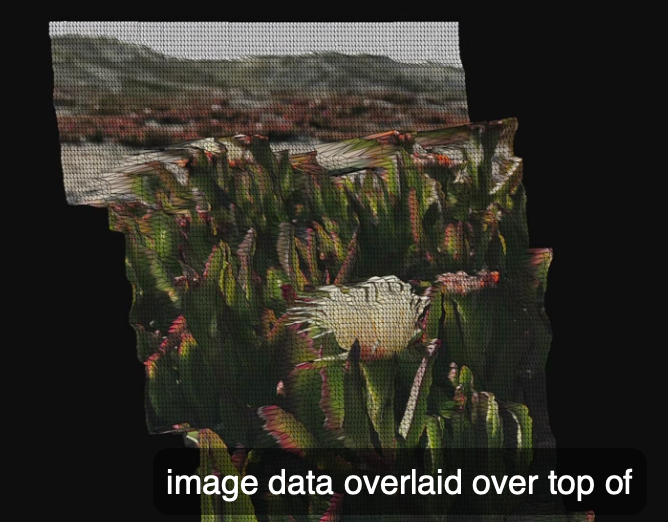

이미지로 돌아와도 이렇게 이미지 데이터가 오버레이로.....신기하네...

.아니 이거 다 할 수 있는거에요??.....진짜 몰라서 그럼

얘네 왜 박수치지??...

아 ~ 씬킷으,로 자기들이 만든 도구라고 합니다...ㅎ 글쿤 ㅎ ㅈㅅㅋ

자 이 Depth데이터를 이용해서 할 수 있는 것들이 많다고 하는데요.

Q : ㅇ ㅑ!!!!!!!!!!!! Depth데이터 사용해서 모할수있는데

A : ㅎㅎ너가 막 이미지 편집하는 앱이면 Depth를 사용해서 새로운 종류의 effect를 만들고

그걸 이미지에 적용할 수 있어

니가 카메라앱이면 Depth를 capture하고 가장 먼저 적용하도록 할 수 있구

공유앱(sharing App)이면 이미지를 공유하기전에 Depth를 활용해서 멋진 effect를 적용할 수도 있다구리~~

뭐 대충 이런 효과 줄 수 있음.

ㅇㅋ

Depth 뭔지 감은 와서 이제 그만볼게..........잘가ㅎ..

그냥 잡담인데 위에서도 잠깐 언급했지만, 이게 7+ 후면카메라에만 있었던건데

아이폰 X이 나오면서......아이폰 X의 핵.심.기.술.."전면 카메라에 TrueDepth카메라 탑재"

TrueDepth카메라는 얼굴인식 기능인 Face ID와 애니모지 기능에 쓰임.

흠 그냥 Depth랑 TrueDepth는 다른거겠죠..!? TrueDepth가 더 진보된 기술이겠지..?

암튼 흠 그냥 제 추측이지만, 저런 사람의 3D..?형태를 가져올 수 있는게

가장 근본적으로는 이 Depth데이터를 기반으로 하는게 아닐까 싶은...!!

그냥 제 추측입니다. 근데 흐름상 그럴것 같은 느낌적인 느낌

위 사진의 출처로 들어가시면 애니모지는 TrueDepth가 필요없다...라는 기사인데 흥미롭네요.

암튼 위에 Depth메모한 글은 WWDC영상은 2017년이었거든요.

때는 2018년.

ㅁㅐㅌ라는게 나오게 됩니다.

아니 맽이거 뭔뜻이야 하고 봤더니

매트블랙..할때 그 매트임..

근데 매트도 Matte, Matt 표현이 다양한것 같은데..암튼 그 매트라고 생각하겠읍니다..

Matte는 한마디로 foreground에서 background로의 분할임

(A portrait matte is a segmentation from foreground to background)

정확하게 말하면, foreground에 1.0, background에 0.0인 mask가 있고

그 사이에서 부드럽고 연속적인 값을 얻음.

portrait matte는 품질이 매우 뛰어나서

저기 확대한 부분보는거랑 같이 머리카락 같은 세밀한 부분까지 보존할 수 있음.

근데 Depth랑은 다르게 항상 Matte데이터를 얻는다는 보장은 할 수 없다고 합니다.

암튼 이 Matte로 할 수 있는건 foreground에서 background로의 깔-끔한 분할이니까..

이런거 할 수 있음.

(내 추측이건데) Depth는

가장 오른쪽 이미지와 같이 Depth값이 서서히 커진다고해야하나...

그러니까 Matte같이 빡!! 분리가 안되어서

깔끔하게 배경에 효과를 넣는다거나 이런거는 Matte를 사용해서 하는게 더 쉬울 것 같네요.

물론 Depth로도 깔끔하게 할 수 있을지도 모르지만.. 암튼 제 그냥 추측입미다..

아주 대충봤을 때 Depth보다 Matte가 더 쉬워보이네요,,,

아무튼 흥미롭네요 XD..

틀린내용이 있다면 댓글로 알려주시면 감사하겠습니당

'공부' 카테고리의 다른 글

| SwiftGen (2) | 2020.04.28 |

|---|---|

| R.swift (0) | 2020.04.28 |

| dyld: Library not loaded: @rpath/XCTest.framework/XCTest (2) | 2020.04.09 |

| Xcode 11.3 ) Swift Package Manager(SPM)과 Build Configuration (1) | 2020.04.09 |

| Xcode 11.4 ) setUpWithError / tearDownWithError, XCTSkipIf / XCTSkipUnless (0) | 2020.04.08 |

- 스위프트 문법

- swift 공부

- ios 13

- 피아노

- UIBezierPath

- Accessibility

- swift tutorial

- actor

- IOS

- WidgetKit

- np-complete

- 회고

- FLUTTER

- SwiftUI

- Combine

- swift sort

- iOS delegate

- Xcode

- github

- WWDC

- Swift

- swift delegate

- swift array

- Git

- WKWebView

- np-hard

- 제이슨 파싱

- fastlane

- 스위프트

- swift3

- Total

- Today

- Yesterday